Quelle: HBS

Handlungsmuster: Hass, Hassrede, Hate-Speech

'Hassrede' lässt sich im rechten Online-Sprektrum immer wieder beobachten. Dabei ist der Ausdruck in der Alltagssprache wie auch in der Forschung mehrdeutig, und in der Praxis werden unterschiedliche Phänomene als 'Hassrede' interpretiert. Gleichzeitig sind 'Hass' und 'Hassrede' im Diskurs auch immer wieder Gegenstand von Debatten und Kontroversen. Über Formen der Hassrede und den Gebrauch von 'Hass' als Schlagwort im rechten Social-Media-Welt informiert dieser Artikel.

Kurzzusammenfassung

Die Ausdrücke ‚Hassrede‘ und ‚Hate Speech‘ bezeichnen allgemein diskriminierenden (rassistischen, sexistischen, chauvinistischen) Sprachgebrauch. Gleichzeitig stellen ‚Hass‘ (und ‚Hass‘ / ‚Hate Speech‘) selbst Themen des (Online-)Diskurses dar, über die politisch gestritten wird. Hassrede wird primär mit rechten oder rechtsextremen Positionen verbunden. In sozialen Medien wie Twitter findet sie häufig in indirekter, verdeckter Form statt, die Sanktionierungen (Löschungen oder Accountsperrungen) erschweren soll. Von rechts wird die Debatte um Hassrede und mit ihr verknüpfte Maßnahmen (der Plattformbetreiber oder der Politik) als Praxis zur Abwehr von Kritik am Mainstream beschrieben, indem allerlei legitime Meinungsäußerungen als ‚Hass‘ stigmatisiert und eine inhaltliche Erwiderung verweigert werde.

Hintergrund

‚Hassrede‘ ist ein Begriff, der sowohl in der (politischen) Alltagskommunikation operativ verwendet wird, als auch im wissenschaftlichen Diskurs zur Beschreibung entsprechender Phänomene Verwendung findet. Dazu kommt, dass ‚Hassrede‘ auch juristische Relevanz haben kann und z.B. Strafverfolgungsbehörden gegen Hassrede vorgehen. Juristisch ist Hassrede jedoch nicht eigenständig definiert, sondern bestimmte Aspekte von dem, was alltäglich als Hassrede verstanden wird, werden durch konkrete Strafrechtsparagraphen definiert (z.B. als Volksverhetzung). ‚Hassrede‘ ist im Deutschen eine Lehnübersetzung von ‚Hate Speech‘ und das Konzept wurde primär aus dem amerikanischen Diskurs übernommen.

Die Grenze zwischen (legitimer) Kritik und (illegitimer) Hassrede ist nicht immer klar zu ziehen und wird subjektiv unterschiedlich definiert: Was den einen als legitime (ggf. überspitzte) Kritik erscheint, nehmen andere als beleidigende Hasspostings wahr. Bekannt und häufig herangezogen werden in diesem Kontext einige prominente Gerichtsentscheidungen, in denen z.B. bekannte Politiker:innen sich (erfolgreich oder erfolglos) gegen ‚Hassrede‘ im Netz zur Wehr setzten. Dies betrifft sowohl Politiker:innen etablierter Parteien als auch Vertreter:innen der AfD.

In der Forschung existieren unterschiedliche Definitionsversuche für Hassrede / Hate Speech. Aus sprachwissenschaftlicher Perspektive lässt sich Hassrede als „den sprachlichen Ausdruck von Hass gegen Personen oder Gruppen verstehen, insbesondere durch die Verwendung von Ausdrücken, die der Herabsetzung und Verunglimpfung von Bevölkerungsgruppen dienen“ (Meibauer 2013: 1). Diese Definition stützt sich zentral auf das Vorkommen bestimmter sprachlicher Ausdrücke (der Autor bezieht sich hierbei insbesondere auf ‚Ethnophaulismen‘, also abwertende Bezeichnungen für ethnisch definierte Gruppen). Diese werden in der Praxis in sozialen Netzwerken allerdings häufig gerade vermieden (siehe unten). Weiter gefasste Begriffsbestimmungen stellen die Merkmale der Öffentlichkeit, Kommunikation und die gruppenbezogene Diskriminierung ins Zentrum: „Im Kern handelt es sich bei Hate Speech um eine Form der kommunikativen Herstellung menschlicher Minderwertigkeit“ (Sponholz 2021: 18).

Im Social-Media-Kontext wird immer wieder auch Kritik am Konzept ‚Hassrede‘ formuliert: Mangels klarer Kriterien für Hassrede könnten praktisch beliebige Phänomene als Hassrede klassifiziert und aus dem legitimen Diskurs ausgegrenzt werden. Das Konzept werde daher auch zur Kritikabwehr verwendet, um unliebsame Stimmen aus der Diskussion auszugrenzen, ohne sich mit ihrem Anliegen beschäftigen zu müssen (siehe unten).

Beispiele und Kontexte

a) Metasprachliche Thematisierungen von ‚Hass‘

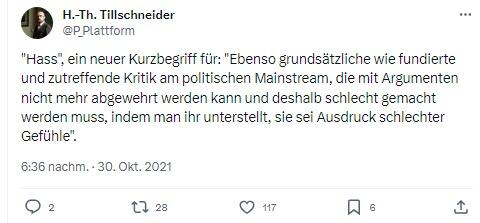

Hassrede wird in sozialen Netzwerken nicht nur praktiziert, sondern ist selbst Gegenstand von Auseinandersetzungen. Hierbei kritisieren rechte Akteure häufig das Konzept und damit verbundene Praktiken, die sich insbesondere gegen rechten oder rechtspopulistischen Sprachgebrauch wenden. Typisch hierfür ist der Tweet eines Repräsentanten der AfD (Screenshot 1), in dem dieser den Gebrauch des Begriffes ‚Hass‘ ironisch kommentiert: Hass sei ein „neuer Kurzbegriff für: ‚Ebenso grundsätzliche wie fundierte und zutreffende Kritik am politischen Mainstream, die mit Argumenten nicht mehr abgewehrt werden kann und deshalb schlecht gemacht werden muss, indem man ihr unterstellt, sie sei Ausdruck schlechter Gefühle‘“. Die Kritik an Hassrede und damit verbundene politische oder administrative Gegenmaßnahmen seien, der Perspektive des Tweets nach, der Versuch des ‚Mainstreams‘, unliebsame Kritik abzuwehren, ohne dieser argumentativ begegnen zu müssen. ‚Hass(-rede)‘ wird hier also als Machttechnik der Eliten beschrieben, und nicht als Kritik an Ausgrenzungen diskriminierter Minderheiten.

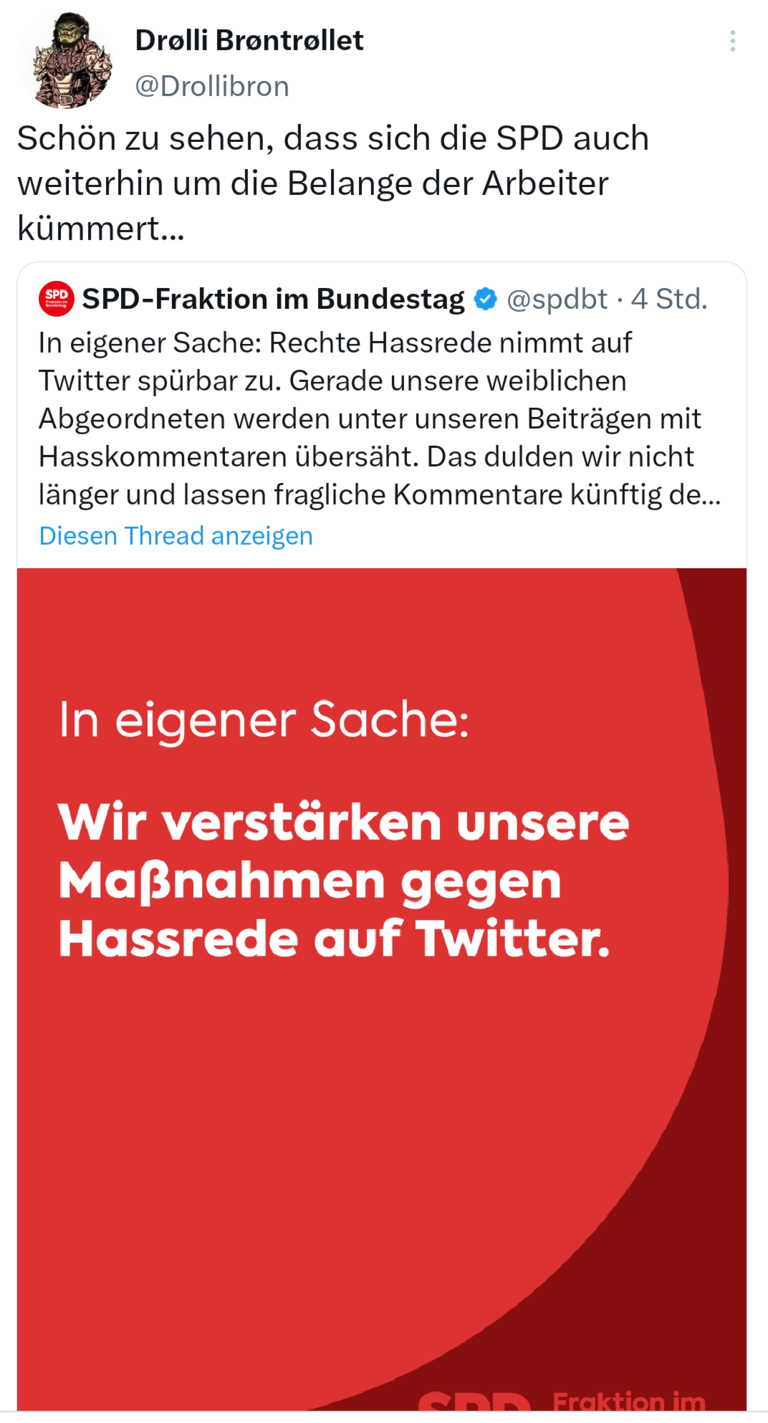

Charakteristisch für derartige Umkehrungen des Konzeptes ist auch das Beispiel aus Screenshot 2: Die Ankündigung des Accounts der SPD-Bundestagsfraktion, die Maßnahmen gegen Hassrede zu intensivieren und vermehrt Postings auszublenden, wird von einem User kommentiert, indem diese Ankündigung als Beleg dafür herangezogen wird, dass sich die SPD nicht mehr um die Anliegen der Arbeiter kümmere. Hier verschränkt sich die Debatte um Hassrede im rechten Diskurs mit Praktiken der Semantischen Aneignung.

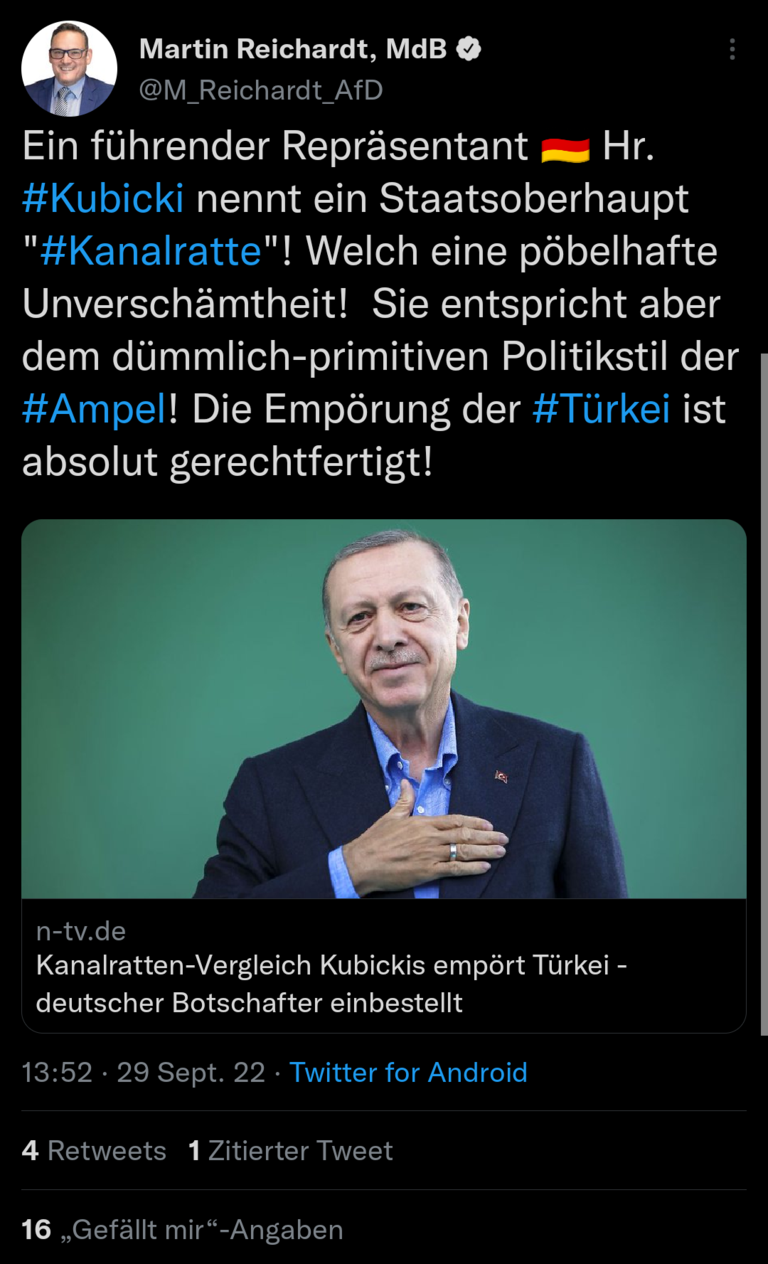

Interessant ist weiterhin, dass das Konzept „Hass(-rede)“ nicht nur ablehnend kommentiert wird. Screenshot 3 zeigt ein Beispiel für die Umkehrung der Stoßrichtung durch rechte Akteure. Ein Politiker der AfD kritisiert den Sprachgebrauch eines FDP-Politikers als „pöbelhafte Unverschämtheit“. Der Vorwurf der Hassrede, der sich üblicherweise gegen rechte Akteure richtet, wird hier umgedreht und gegen einen Repräsentanten der Regierung gewendet.

-

Quelle: Twitter

Screenshot 1: Metasprachliche Thematisierungen von ‚Hass(rede)‘ -

Quelle: Twitter

Screenshot 2: Metasprachliche Thematisierungen von ‚Hass(rede)‘ -

Quelle: Twitter

Screenshot 3: Metasprachliche Thematisierungen von ‚Hass(rede)‘

b) Verdeckte Hassrede, ‚Dogwhistling‘

Offene Hassrede, die sich insbesondere durch diskriminierende Ausdrücke auszeichnet, wird in den sozialen Netzwerken und auch bei Twitter mit administrativen Maßnahmen verbunden. Offene Hassrede stellt insbesondere einen häufigen Anlass für Löschungen von Tweets oder Accountsperrungen dar (oder sind sogar Anlass für Strafverfolgungsmaßnahmen). Daher vermeiden die meisten rechten User einen Sprachgebrauch, der zur Löschung des Accounts führen könnte. Das gilt jedenfalls für ‚wertvolle‘ Accounts, die dauerhaft betrieben werden sollen und möglicherweise über eine Reichweite verfügen, die bei einer Löschung nicht einfach wieder hergestellt werden könnte. Eine Ausnahme davon stellen Sifftwitteraccounts dar, die für offen beleidigende oder diskriminierende Postings beim Trollen verwendet werden. Die Löschung wird hierbei in Kauf genommen und meist umgehend durch neuangelegte Profile umgangen, die (z.B. durch die Nutzung bestimmter sprachlicher oder ästhetischer Merkmale) für die Mitglieder der eigenen Community identifizierbar sind und so in kurzer Zeit ihre Follower wieder herstellen können.

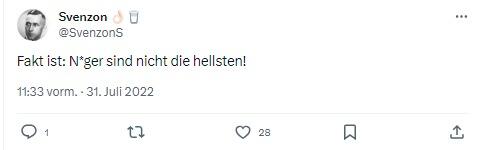

Zur Erschwerung von administrativen Maßnahmen wird Hassrede daher häufig codiert oder in indirekter Form gepostet, wobei die Aussage für die eigene Community und/oder die konfrontierten Personen verständlich bleibt. Eine typische Praktik in diesem Kontext sind Tweetketten, wobei die beteiligten User nur einen Buchstaben posten, die Antworten zusammen aber einen diskriminierenden oder beleidigenden Ausdruck ergeben. So werden z.B. missliebige Äußerungen migrantischer User mit Tweets beantwortet, die zusammen ‚A – B – S – C – H – I – E – B – E – N – ! ‘ ergeben. Auch andere rassistische oder diskriminierende Ausdrücke werden nach diesem Muster gepostet, wobei das Posten eines einzelnen Buchstabens für die Beteiligten meist nicht sanktioniert wird (vgl. Screenshot 4). Vergleichbar sind Praktiken wie das Auslassens eines einzelnen Buchstabens in diskriminierenden Ausdrücken (vgl. Screenshot 5) oder ganzer Wörter, die durch Vervollständigung eines Reims ergänzt werden können (Screenshot 6).

Von diesen Formen der verdeckten Hassrede können im engeren Sinne codierte Formen von Hassrede unterschieden werden, deren Sinn für Außenstehende nicht zu erschließen ist (und auch nicht soll), sondern nur von Gleichgesinnten verstanden wird. Die Forschung spricht bei derartigen, nach Außen unverfänglich erscheinenden Äußerungen, die für die eigene Community eine andere Bedeutung annehmen können auch von „Dogwhistling“. Die Unverständlichkeit über die eigene Community hinaus bedingt, dass ‚Dogwhistling‘ einen sehr begrenzten Nutzen als Mittel der strategischen Kommunikation hat und entsprechend selten in unseren Daten zu beobachten ist.

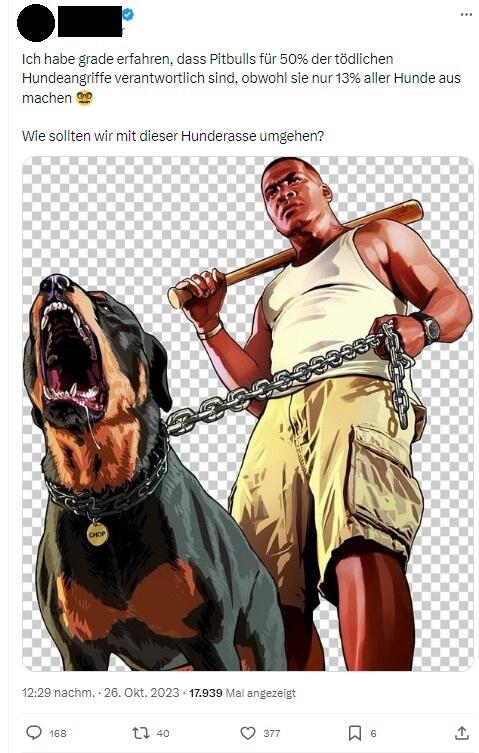

Screenshot 7 zeigt ein Posting, dass vermeintlich die Aggressivität von Hunderassen behandelt. Tatsächlich verweisen die angegebenen Prozentwerte auf den Anteil Schwarzer an der Gesamtbevölkerung der USA (13%) sowie auf den vermeintlichen Anteil afroamerikanischer Täter bei begangenen Morden (hier 50%, häufig wird auch 53% verwendet). Die so codierte Behauptung einer massiven Überrepräsentanz von Afroamerikanern als Täter bei Kapitalverbrechen wird mit der Frage, wie wir ‚mit dieser Hunderasse umgehen sollten?‘ verbunden und die rassistische Grenzüberschreitung noch verstärkt.

-

Quelle: Twitter

Screenshot 4: Tweetketten -

Quelle: Twitter

Screenshot 5: ‚Dogwhistling‘ und verdeckte Hassrede -

Quelle: Twitter

Screenshot 6: ‚Dogwhistling‘ und verdeckte Hassrede -

Quelle: Twitter

Screenshot 7: ‚Dogwhistling‘

c) Hassrede in Memes

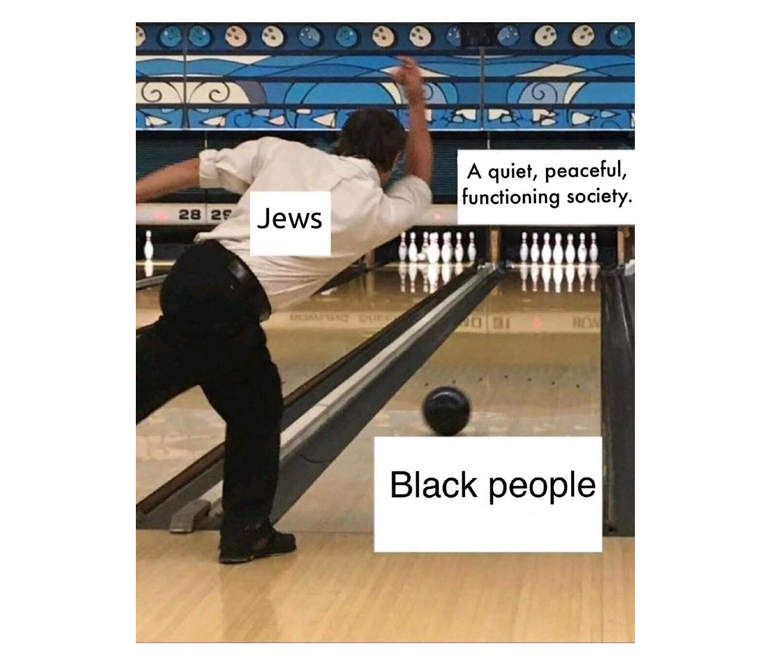

Hass gegen bestimmte Bevölkerungsgruppen wird auch in Form von Memes (Bilder mit prägnanten Kurzkommentaren) ausgedrückt. Auch hier ist die diskriminierende Aussage nicht immer auf den allerersten Blick ersichtlich. Im dargestellten Beispiel des ‚Bowler Memes‘ (Screenshot 8) wird ein Mann dargestellt, der gerade eine Bowlingkugel geworfen hat, die auf die Pins zuläuft. Der Mann wird hier mit „Jews“ beschriftet und die Kugel mit „Black People“. Die Pins stehen in dieser Variante des Memes für eine „quiet, peaceful, functioning society“. Das Meme drückt somit die antisemitische und verschwörungstheoretische Vorstellung aus, dass Juden hinter der Migration vor allem schwarzer Menschen in die westlichen Gesellschaften stehen, die hiermit zerstört werden sollen.

Zitierte Literatur

- Meibauer, Jörg (2013): Hassrede – von der Sprache zur Politik. In Meibauer, Jörg (Hg.): Hassrede / Hate Speech. Interdisziplinäre Beiträge zu einer aktuellen Diskussion. Gießener Elektronische Bibliothek. 1–16.

- Sponholz, Liriam (2021): Hass mit Likes: Hate Speech als Kommunikationsform in den Social Media. In: Wachs, Sebastian; Koch-Priewe, Barbara; Zick, Andreas (Hg.): Hate Speech - Multidisziplinäre Analysen und Handlungsoptionen. Wiesbaden: Springer VS. 15-37.